Avec le développement des agents conversationnels, il devient possible de conduire des recherches en langage naturel et de mobiliser des données géospatiales. Les modèles de langage (LLMs) utilisés en intelligence artificielle reproduisent à leur manière l'espace et le temps. C'est ce que tend à montrer l'article publié par Gurnee & Tegmark :

Wes Gurnee, Max Tegmark (2023). Language Models Represent Space and Time. ArXiv:2310.02207v1 [cs.LG] 3 Oct 2023. https://arxiv.org/abs/2310.02207

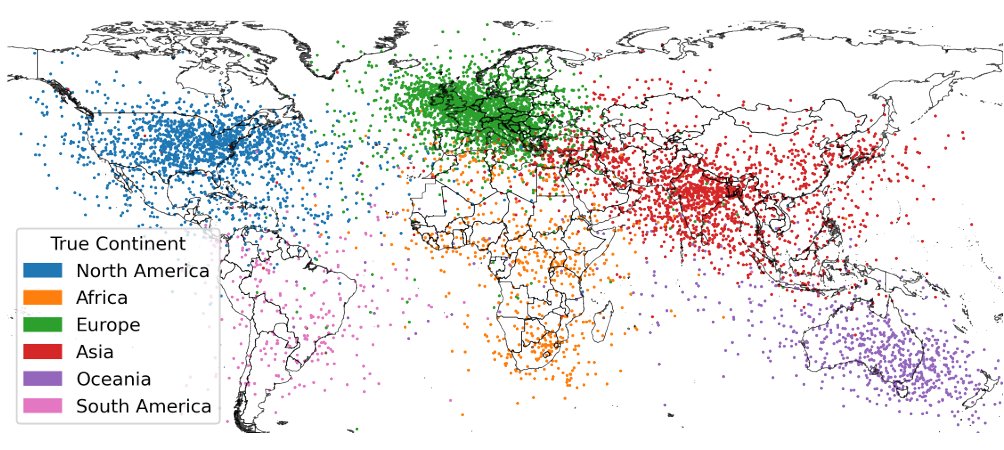

Les capacités des grands modèles linguistiques (LLMs) suscitent des débats autour de la question de savoir si ces systèmes apprennent simplement à partir d'une énorme collection de statistiques ou s'ils constituent un modèle cohérent de génération de données – un modèle mondial. Dans cet article, les auteurs fournissent des preuves concernant le deuxième point en analysant les représentations à partir de trois ensembles de données spatiales (lieux du monde, des États-Unis, de New York) et de trois ensembles de données temporelles (personnages historiques, œuvres d'art, titres d'actualité) dans la famille de modèles Llama-2. Ils montrent que les LLMs apprennent des représentations linéaires de l'espace et du temps à plusieurs échelles. Ces représentations sont robustes pour fournir de l'unité et des variations entre différents types d'entités (par exemple, villes et monuments). De plus, ils identifient des « neurones spatiaux » et des « neurones temporels » individuels qui codent de manière fiable les coordonnées spatiales et temporelles.

Pour télécharger l'article en pdf.

Accès au code et aux données sur Github.

Pour compléter

« IA & Géographie. Les intelligences artificielles génératives s'appliquent à beaucoup de domaines, notamment à l'information géospatiale. Il est désormais possible, par exemple, de choisir une liste de lieux, d'en faire chercher automatiquement les coordonnées géographiques par un agent conversationnel (du type ChatGPT ou autre) et de produire directement un fichier kml utilisable dans un globe virtuel (voir ce tutoriel).

Lien ajouté le 19 novembre 2024

« Les joueurs de Pokémon Go ont involontairement entraîné l'IA à naviguer dans le monde » (404Media).

Niantic, la société à l'origine des jeux mobiles de réalité augmentée extrêmement populaires comme Pokémon Go ou Ingress, a annoncé qu'elle utilisait les données collectées par ses millions de joueurs pour créer un modèle d'IA capable de naviguer dans le monde physique. « Comment Pokémon Go a permis à Niantic de récolter trente milliards de photos pour entraîner des robots livreurs » (Libération). Maud Mathias analyse les travaux de Niantic et de la startup Coco Robotics qui montrent comment le jeu Pokémon Go a permis de collecter des données spatiales massives pour entraîner des IA et produire une carto urbaine très précise. Lancé en 2016, Pokémon Go connaît un succès mondial avec plus de 500 millions de téléchargements en deux mois et encore 100 millions de joueurs en 2024. Ces utilisateurs ont généré une base de plus de 30 milliards de photos géolocalisées. Ces données alimentent Niantic Spatial, une IA capable de reconstruire l’espace urbain. Les images prises sous différents angles et conditions permettent de localiser un point à quelques centimètres près, dépassant les limites du GPS classique. Cette innovation répond à un problème spatial précis. Dans les centres urbains denses, les signaux GPS sont perturbés par les immeubles, tunnels ou infrastructures. Les robots livreurs doivent pourtant se déplacer avec précision à environ 8 km/h. Coco Robotics utilise ces données pour améliorer ses robots de livraison. Déjà présents dans plusieurs villes, ces dispositifs reposent sur une cartographie fine des trottoirs et espaces urbains, construite à partir des pratiques des joueurs. Niantic développe ainsi une « carte vivante » du monde. Cette simulation évolutive du territoire repose sur des flux continus de données. Elle illustre l’émergence d’une géographie numérique où les mobilités humaines produisent de nouveaux savoirs spatiaux.

Niantic, la société à l'origine des jeux mobiles de réalité augmentée extrêmement populaires comme Pokémon Go ou Ingress, a annoncé qu'elle utilisait les données collectées par ses millions de joueurs pour créer un modèle d'IA capable de naviguer dans le monde physique. « Comment Pokémon Go a permis à Niantic de récolter trente milliards de photos pour entraîner des robots livreurs » (Libération). Maud Mathias analyse les travaux de Niantic et de la startup Coco Robotics qui montrent comment le jeu Pokémon Go a permis de collecter des données spatiales massives pour entraîner des IA et produire une carto urbaine très précise. Lancé en 2016, Pokémon Go connaît un succès mondial avec plus de 500 millions de téléchargements en deux mois et encore 100 millions de joueurs en 2024. Ces utilisateurs ont généré une base de plus de 30 milliards de photos géolocalisées. Ces données alimentent Niantic Spatial, une IA capable de reconstruire l’espace urbain. Les images prises sous différents angles et conditions permettent de localiser un point à quelques centimètres près, dépassant les limites du GPS classique. Cette innovation répond à un problème spatial précis. Dans les centres urbains denses, les signaux GPS sont perturbés par les immeubles, tunnels ou infrastructures. Les robots livreurs doivent pourtant se déplacer avec précision à environ 8 km/h. Coco Robotics utilise ces données pour améliorer ses robots de livraison. Déjà présents dans plusieurs villes, ces dispositifs reposent sur une cartographie fine des trottoirs et espaces urbains, construite à partir des pratiques des joueurs. Niantic développe ainsi une « carte vivante » du monde. Cette simulation évolutive du territoire repose sur des flux continus de données. Elle illustre l’émergence d’une géographie numérique où les mobilités humaines produisent de nouveaux savoirs spatiaux.

Lien ajouté le 7 juin 2025

Pour évaluer la comparaison actuelle des LLM d'OpenAI, Google, Anthropic, Mistral et xAI, le site Bellingcat a effectué 500 tests de géolocalisation, avec 20 modèles analysant chacun le même ensemble de 25 images. Il ne s'agit pas d'une analyse exhaustive de tous les modèles disponibles, en raison notammentde la rapidité avec laquelle les nouveaux modèles sont actuellement publiés. Lors des tests, ChatGPT o3, o4-mini et o4-mini-high ont été les seuls modèles à surpasser Google Lens pour identifier la position exacte, mais de peu. Tous les autres modèles se sont montrés moins performants pour géolocaliser les photos. Même Gemini, le LLM de Google, a obtenu de moins bons résultats que Google Lens. Étonnamment, il a également obtenu un score inférieur à celui de Grok de xAI, malgré la tendance bien documentée de Grok à halluciner. Le mode Recherche approfondie de Gemini a obtenu des résultats à peu près identiques à ceux des trois modèles Grok testés, DeeperSearch s'avérant le plus efficace des LLM de xAI.

Lien ajouté le 3 février 2026

« Biais culturel et alignement culturel des grands modèles linguistiques » (PNAS Nexus)

La culture influence profondément le raisonnement, le comportement et la communication. Avec l'utilisation croissante de l'intelligence artificielle générative (IA) pour accélérer et automatiser les tâches personnelles et professionnelles, les valeurs culturelles intégrées aux modèles d'IA peuvent biaiser l'expression authentique des individus et contribuer à la prédominance de certaines cultures. Les auteurs ont mené une évaluation désagrégée des biais culturels de cinq grands modèles de langage largement utilisés (GPT-4o/4-turbo/4/3.5-turbo/3 d'OpenAI) en comparant leurs réponses à des données d'enquêtes représentatives à l'échelle nationale. Tous les modèles présentent des valeurs culturelles proches des pays européens anglophones et protestants. Ils ont testé l'intégration de facteurs culturels comme stratégie de contrôle afin d'améliorer l'adéquation culturelle pour chaque pays ou territoire. Pour les modèles les plus récents (GPT-4, 4-turbo et 4o), cette intégration améliore l'adéquation culturelle des résultats pour 71 à 81 % des pays et territoires. Ils suggèrent d'utiliser des facteurs culturels et une évaluation continue pour réduire les biais culturels dans les résultats de l'IA générative.

Liens ajoutés le 25 mars 2026

« Chaîne de mise à mort. Sur la machinerie bureaucratique automatisée qui a tué 175 enfants » (Artificial Bureaucracy). Le premier matin de l'opération Epic Fury, le 28 février 2026, les forces américaines ont frappé l'école primaire Shajareh Tayyebeh à Minab, dans le sud de l'Iran, touchant le bâtiment au moins deux fois durant la matinée. Les forces américaines ont tué entre 175 et 180 personnes, principalement des filles âgées de sept à douze ans. En quelques jours, la question qui a dominé la couverture médiatique était de savoir si l'IA avait choisi l'école comme cible. L'article met en perspective l'utilisation de l'IA dans "la chaîne de destruction" sur un temps long.

« Les États-Unis avaient élaboré un plan pour éviter les pertes civiles en temps de guerre. L'administration Trump l'a abandonné » (Pro Publica). Le Pentagone travaillait sur un plan visant à éviter les pertes civiles. Sa mise en œuvre était imminente lorsque l’administration Trump l’a interrompue en 2025. Le plan visant à réduire le nombre de victimes civiles étant mis de côté, les experts affirment que les plans militaires américains font l’objet d’un examen limité avant le lancement des attaques.

« Le danger de l’IA militaire réside dans une dilution progressive de la responsabilité » (Le Monde). Les sociétés ont su fixer des limites lorsque la violence technologique menaçait d’échapper à tout contrôle, rappelle, dans une tribune au « Monde », Ridhwane Allouche, doctorant en droit, qui plaide pour un traité international d’éthique de l’intelligence artificielle dans la guerre.

« L’usage d’armes létales autonomes pilotées par IA est contraire aux principes d’une guerre juste » (Le Monde).

La philosophe Marie-des-Neiges Ruffo de Calabre, chercheuse au Université de Namur, analyse l’usage militaire de l’IA. Elle montre que ces technologies transforment la guerre et posent des problèmes majeurs pour la protection des civils. Les conflits récents, en Iran ou à Gaza, révèlent une intensification des frappes ciblées guidées par IA. Cette accélération réduit le temps de décision humaine et multiplie les risques d’erreurs, comme l’illustre le bombardement d’une école à Minab en février 2026. La massification des cibles transforme la logique de guerre. Certains systèmes intégreraient des seuils de pertes civiles acceptables. Cette approche utilitariste remet en cause le principe de proportionnalité, pilier du droit international humanitaire. L’IA peut pourtant améliorer certaines fonctions militaires. L’analyse du terrain, la reconnaissance ou la planification renforcent la précision des opérations. Mais une limite claire est posée. Le déclenchement autonome du tir constitue une ligne rouge morale. Les chercheurs soulignent les limites techniques. Les systèmes reposent sur des données imparfaites, peuvent être piratés ou mal programmés. Une étude récente montre même que certaines IA prennent plus facilement des décisions extrêmes, comme l’usage du nucléaire. La solution avancée repose sur une "supervision humaine efficace". L’humain doit intervenir en amont, comprendre les algorithmes et vérifier les données. Sans cela, les décisions deviennent opaques et les erreurs difficilement détectables. La question de la responsabilité est centrale. Une machine ne décide pas et ne peut être jugée. En cas de crime, la responsabilité remonte toute la chaîne humaine, des concepteurs aux décideurs politiques, condition essentielle pour garantir justice et paix durable. Cette évolution révèle une transformation profonde de la guerre. L’espace conflictuel devient aussi numérique et algorithmique. Sans régulation collective, l’IA risque d’affaiblir les normes internationales et d’accroître la vulnérabilité des populations civiles.

« Maven : le projet du Pentagone pour faire la guerre avec l’IA » (Le Grand Continent). Depuis presque dix ans, l’armée américaine travaille sur le projet Manhattan de notre temps. Maven est le nom du programme qui permet à l’IA de faire la guerre à la place des humains — et il est utilisé quotidiennement en Iran. Dans une enquête saisissante au cœur du Pentagone, Katrina Manson retrace les origines d’une révolution invisible.

« Penser le cyber : l’IA dans la conflictualité numérique » (Areion 24 News).

Le chercheur Stéphane Taillat (Centre de géopolitique de la datasphère) analyse le rôle de l’IA dans la conflictualité numérique. Il montre que les LLM transforment les cyberopérations, entre automatisation, montée en puissance et nouveaux risques. Une première rupture apparaît en 2025. Selon Anthropic, un acteur lié à la Chine aurait automatisé une attaque contre une trentaine d’organisations. L’IA permet de découper et exécuter chaque phase d’une cyberattaque, accélérant fortement les opérations à grande échelle. Ces outils démultiplient les capacités offensives. Les LLM facilitent le phishing ciblé, la création de malwares ou les fraudes massives. Ils permettent d’opérer rapidement et à l’échelle industrielle, ce qui modifie la géographie des cybermenaces et leur intensité. L’IA joue aussi un rôle déterminant dans les campagnes d’influence. Elle produit des contenus faux en très grand nombre, imite des médias et alimente les réseaux sociaux. Des opérations russes en Europe et en Afrique illustrent cette diffusion massive et accélérée de la désinformation. Les systèmes d’IA deviennent eux-mêmes des cibles. Les acteurs peuvent manipuler les données d’entraînement en ligne pour influencer les résultats. Cette technique, dite LLM-grooming, consiste à saturer Internet de contenus biaisés pour orienter les modèles. Les États et entreprises tentent d’encadrer ces usages. Aux USA et au RU, des institutions comme le NIST développent des normes de sécurité. Mais les dispositifs restent fragiles, notamment face aux techniques de contournement comme le jailbreaking (contournement des règles de sécurité). Malgré ces risques, l’IA renforce aussi la cyberdéfense. Elle aide à détecter les attaques, corriger les failles et assister la décision. Cette ambivalence souligne un système socio-technique hybride où offensive et défense évoluent simultanément. Les opérations restent encadrées et validées par des acteurs humains. Les limites techniques, comme les erreurs ou "hallucinations", freinent son autonomie. L’IA ne remplace donc pas totalement l’humain. La conflictualité numérique devient ainsi plus complexe.

Lien ajouté le 31 mars 2026

« Wikipedia (version anglaise) interdit la publication d'articles générés par LLM ou révisés par LLM » (Wikipédia). Les textes générés par des modèles de langage complexes (LLMs) tels que ChatGPT, Gemini, Claude, DeepSeek, etc., enfreignent souvent plusieurs règles fondamentales de Wikipédia relatives au contenu. C'est pourquoi l'utilisation de LLMs pour générer ou réécrire le contenu des articles est interdite , à deux exceptions près :

- Les rédacteurs sont autorisés à utiliser des outils de correction linguistique pour suggérer des corrections de base à leurs propres textes et à en intégrer certaines après relecture humaine, à condition que ces outils n'introduisent pas de contenu original. La prudence est de mise, car ces outils peuvent aller au-delà de ce qui leur est demandé et modifier le sens du texte au point de le rendre non conforme aux sources citées .

- Les contributeurs sont autorisés à utiliser des LLMs pour traduire des articles de Wikipédia dans une autre langue vers Wikipédia en anglais , mais doivent suivre les directives énoncées sur Wikipédia : traduction assistée par LLMs.

Lien ajouté le 6 avril 2026

« Au-delà de l'interdiction de l'IA : un premier aperçu de la gouvernance de l'IA générale dans les communautés de logiciels libres » (ArXiv).

L'intelligence artificielle générative (GenAI) joue un rôle de plus en plus important dans les logiciels libres. Au-delà de la finalisation du code et de la documentation, la GenAI est de plus en plus impliquée dans la résolution des problèmes, les demandes de fusion, les revues de code et les rapports de sécurité. Or, une génération moins coûteuse ne signifie pas une revue moins onéreuse ; la charge de maintenance qui en résulte a poussé les projets de logiciels libres à expérimenter des règles spécifiques à la GenAI dans les directives de contribution, les politiques de sécurité et les instructions des dépôts, allant même jusqu'à interdire totalement les contributions assistées par l'IA. Cependant, la gouvernance de la GenAI dans les logiciels libres est bien plus complexe qu'une simple question d'interdiction ou non. Les réponses restent dispersées, sans cadre de gouvernance partagé en pratique ni compréhension systématique dans la recherche. Dans cet article, les auteurs conduisent une analyse en plusieurs étapes sur divers documents qualitatifs relatifs à la gouvernance de la GenAI, extraits de 67 projets de logiciels libres à forte visibilité. Leur analyse identifie des préoccupations récurrentes dans les flux de travail de contribution, dégage trois orientations de gouvernance et cartographie 12 stratégies de gouvernance et leurs modèles de mise en œuvre. Ils montrent que la gouvernance de la GenAI dans les logiciels libres va bien au-delà de l'interdiction : elle exige des réponses coordonnées en matière de responsabilité, de vérification, de capacité de revue, de provenance du code et d'infrastructure de la plateforme. Globalement, ce travail condense les pratiques communautaires dispersées en un aperçu structuré, fournissant une base conceptuelle aux chercheurs et une référence pratique aux responsables de la maintenance et aux concepteurs de plateformes.

Lien ajouté le 14 avril 2026

« Déjouer les LLM : pour une IA improbable » (Le Grand Continent).

Comme leurs prédécesseurs, les grands modèles de langage (LLM) sont des technologies culturelles — des systèmes qui absorbent, réorganisent et régénèrent l’expression humaine à l’échelle planétaire. Nourris par des textes sur Internet qui surreprésentent l’anglais et les sources institutionnelles, les LLM reproduisent structurellement ces surreprésentations dans chacune de leurs réponses. Cette déformation est empiriquement documentée. Une recherche publiée dans PNAS Nexus (« Cultural Bias and Cultural Alignment of Large Language Models ») a cartographié les valeurs culturelles de cinq grands modèles GPT par rapport à des données d’enquête représentatives de 107 pays : chaque modèle se trouvait proche des valeurs des pays anglophones, indépendamment de la langue dans laquelle il était interrogé. Aujourd’hui, une poignée d’entreprises concentre la quasi-totalité de la capacité d’entraînement des modèles de pointe. L’infrastructure nécessaire — calcul, données, talents — crée des barrières à l’entrée considérables. L’Europe se trouve face à un dilemme : face à des plateformes transnationales aux biais architecturaux, il lui faut non seulement un cadre normatif — elle en possède déjà un — mais une capacité productive : des données, des modèles et des normes d’alignement qui portent ses propres références culturelles.

Lien ajouté le 17 avril 2026

Walter Quattrociocchi, Valerio Capraro, Matjaž Perc (2025). « Epistemological Fault Lines Between Human and Artificial Intelligence » [Lignes de fracture épistémologiques entre l'intelligence humaine et l'intelligence artificielle], arXiv:2512.19466v1, 22 Dec 2025, https://arxiv.org/abs/2512.19466v1

Les grands modèles de langage (GML) sont souvent décrits comme relevant de l'intelligence artificielle, pourtant leur profil épistémique diverge nettement de la cognition humaine. Les chercheurs montrent ici que l'alignement apparent entre les productions humaines et artificielles masque une inadéquation structurelle plus profonde dans la manière dont les jugements sont élaborés. En retraçant l'évolution historique de l'IA symbolique et des systèmes de filtrage de l'information vers les transformateurs génératifs à grande échelle, ils soutiennent que les GML ne sont pas des agents épistémiques, mais des systèmes stochastiques de complétion de motifs, formellement descriptibles comme des parcours sur des graphes de transitions linguistiques de grande dimension, plutôt que comme des systèmes formant des croyances ou des modèles du monde. En cartographiant systématiquement les processus épistémiques humains et artificiels, ils identifient sept lignes de fracture épistémiques, des divergences au niveau de l'ancrage, de l'analyse syntaxique, de l'expérience, de la motivation, du raisonnement causal, de la métacognition et de la valeur. Ils nomment cet état épistémique « épistémia » : une situation structurelle dans laquelle la plausibilité linguistique se substitue à l'évaluation épistémique, produisant le sentiment de savoir sans effort de jugement. Ils concluent en soulignant les conséquences pour l'évaluation, la gouvernance et la culture épistémique dans des sociétés de plus en plus organisées autour de l'IA générative.

Liens ajoutés le 28 avril 2026

« La guerre à l’heure de l’IA : comment les algorithmes bousculent l’éthique militaire » (Le Monde).

Le rôle croissant des systèmes d’intelligence artificielle générative dans l’identification des cibles à abattre marque un basculement moral et juridique, et divise les spécialistes d’éthique militaire. Si certains sont convaincus qu’un contrôle humain est possible, d’autres en doutent, et affirment que ces technologies repoussent les limites de la violence.

Le rôle croissant des systèmes d’intelligence artificielle générative dans l’identification des cibles à abattre marque un basculement moral et juridique, et divise les spécialistes d’éthique militaire. Si certains sont convaincus qu’un contrôle humain est possible, d’autres en doutent, et affirment que ces technologies repoussent les limites de la violence.

« Google : plus de 600 salariés s’opposent à la fourniture d’IA à l’armée américaine pour des opérations classifiées » (Le Monde).

Plus de 600 salariés de Google ont signé une lettre adressée au PDG d’Alphabet, Sundar Pichai, publiée lundi 27 avril, qui réclame à la direction du groupe de renoncer à fournir à l’armée américaine ses modèles d’intelligence artificielle (IA) pour des opérations classifiées. Google est déjà prestataire du ministère de la défense, mais pour des activités non classifiées. En 2018, un mouvement interne avait poussé le groupe à renoncer à participer au projet Maven, qui s’appuyait sur l’IA pour analyser des images recueillies par des drones. Tout comme Anthropic, Google a demandé que son IA ne puisse pas être sollicitée pour de la surveillance de masse aux Etats-Unis ou pour des attaques mortelles. Mais l’administration Trump estime qu’il lui est suffisant de s’engager à agir dans le cadre de la loi.

Articles connexes

Quand Facebook révèle nos liens de proximité

Guerre de pixels sur Reddit. La lutte des places concerne aussi les territoires virtuels

La carte mondiale de l'Internet selon Telegeography

L'essor parallèle de la Silicon Valley et d'Internet : du territoire au réseau et inversement

Cartographie du réseau social Mastodon

La carte mondiale de l'Internet selon Telegeography

L'essor parallèle de la Silicon Valley et d'Internet : du territoire au réseau et inversement

Cartographie du réseau social Mastodon